Vous êtes ici

Notre quotidien au filtre des traitements algorithmiques

ParcourSup, impôts, SNCF, banques, achats en ligne… Que sont au juste ces outils informatiques qui permettent de réaliser diverses tâches en ligne ?

François Pellegrini1. Contrairement à ce qui est souvent avancé par le grand public, il ne s’agit pas d’« algorithmes », mais de « traitements algorithmiques ». Précisons qu’un algorithme correspond à une suite d'instructions et d’opérations exprimées en langage mathématique, permettant de résoudre un problème. Un « logiciel » est lui un code informatique exécutable par un ordinateur, qui décrit comment appliquer un ou plusieurs algorithmes à certaines données. Enfin un traitement algorithmique correspond à la mise en œuvre d’un tel logiciel, pour une finalité particulière. Pour revenir aux objets dont il est question ici, il s’agit de traitements algorithmiques destinés à traiter de façon automatisée des données pour effectuer des tâches intellectuelles qui étaient jusque-là confiées à des humains.

Quand ces outils ont-ils commencé à être déployés ?

F. P. Dès la fin du XIXe siècle ! En effet, en 1890, la société étasunienne Tabulating Machine Company a procédé, pour la première fois, au recensement de la population des États-Unis de manière semi-automatisée, grâce à des cartes perforées2. Ceci dit, le traitement automatisé de données tel qu’on le connaît aujourd’hui n’a vraiment décollé qu’après l’arrivée de l’ordinateur électronique en 1948, et la démocratisation de l’internet dans les années 1990, qui a rendu possible la saisie massive de données en ligne. En France, le Minitel a été précurseur pour les démarches à distance.

Pourquoi les traitements algorithmiques ne cessent de gagner du terrain ?

F. P. Parce qu’ils présentent plusieurs atouts. Tout d’abord, ils permettent un traitement des données plus rapide, en quelques clics. Cela, sans avoir à se déplacer, et même en dehors des heures ou des jours non ouvrés. Ensuite, ils diminuent les coûts liés au recueil des données, (réalisé désormais par les usagers eux-mêmes et non plus des employés) et à leur traitement (effectué par des machines). Enfin, ces outils délivrent les humains de tâches ennuyeuses pour leur permettre de se focaliser sur des tâches intellectuelles à valeur ajoutée.

Oui, mais il existe des revers de la médaille à ce tout-numérique, non ?

F. P. : Absolument ! Au niveau économique, en libérant des humains des tâches désormais automatisées, les traitements algorithmiques contribuent à la disparition de postes peu qualifiés et peuvent donc être préjudiciables à l’emploi. D’un point de vue social, comme certaines zones ou certains foyers sont mal ou pas du tout desservis par Internet et que certaines personnes ne maîtrisent pas les outils numériques (on parle de « fracture numérique »), ces systèmes peuvent renforcer les inégalités d’accès à certains services, les jeunes et les citadins étant en général favorisés par rapport aux ruraux et seniors. Enfin, côté qualité du service rendu, en plus de déshumaniser la relation client, les traitements automatisés proposent un éventail de services généralement restreint, et les assistants conversationnels, ou « chatbots », sont souvent très frustrants !

Pourquoi ces limites au niveau du service rendu ?

F. P. Parce que les programmes de ces traitements codent une règle inflexible, à laquelle ils ne peuvent pas déroger. Un programme informatique est incapable de s’adapter, alors que l’humain est doté d’une certaine souplesse, d’un libre arbitre lui permettant de désobéir à une loi s’il l’estime non adaptée, et d’une capacité à innover. Ensuite, pour un même traitement de données, un humain utilisera les mêmes informations, mais s’appuiera en plus sur des signaux non verbaux, sur son ressenti, afin de proposer une solution adaptée. De fait, si, pour certaines tâches spécifiques, les traitements algorithmiques peuvent faire aussi bien voire mieux que l’humain (comme gagner aux échecs), c’est plus compliqué pour d’autres tâches nécessitant la prise en compte de critères d’évaluation inconnus au moment de la programmation du logiciel ou difficiles à coder (notamment les enjeux éthiques). Cette limite va à l’encontre d’une pensée – assez critiquable – selon laquelle tout problème social aurait une solution d’ordre technologique ; ce que le chercheur en histoire des sciences étasunien Evgeny Morozov a appelé le « solutionnisme technologique ».

Quid du risque d’utilisation abusive des données personnelles (nom, âge, adresse, etc.), transmises aux traitements algorithmiques ?

F. P. Effectivement, ces outils permettent à l’administration et à des acteurs privés de collecter énormément de données sur les gens, lesquelles peuvent être utilisées à l’insu des personnes, à des fins autres que celles prévues initialement. Notamment, ces stocks de données peuvent favoriser un fichage général de la population et permettre de la surveiller dans ses moindres faits et gestes. Par exemple, début 2022, la police allemande s’est attirée de vives critiques après avoir utilisé illégalement des données personnelles contenues dans une application de traçage anti-Covid, pour retrouver des témoins d’une rixe qui a provoqué le décès d’un homme dans un bar en novembre 2021. Il y a aussi le risque d’accès illicite aux données personnelles par des cybercriminels (piratage), qui peuvent les copier et les marchander. En effet, comme ces informations se trouvent dans des centres de données connectés à Internet, la surface d’attaque possible depuis le monde entier est plus importante que lorsqu’elles étaient localisées dans un bâtiment à un endroit bien précis...

Comment l’utilisateur est-il protégé de ce type de dérives ?

F. P. Par des solutions la fois techniques (cybersécurité) et juridiques. Ici, il existe en France la loi « informatique et libertés » qui régule l’utilisation des données personnelles. Ce texte a été adopté dès 1978, quand l’administration a voulu lancer un projet qui a fait craindre le fichage de toute la population3. Il vise à garantir que le développement de l'informatique se réalise dans le respect de la vie privée, et des libertés individuelles et publiques.

Mais cette loi de 1978 a été adoptée bien avant le boom de l’internet et des traitements automatisés... A-t-elle été améliorée depuis ?

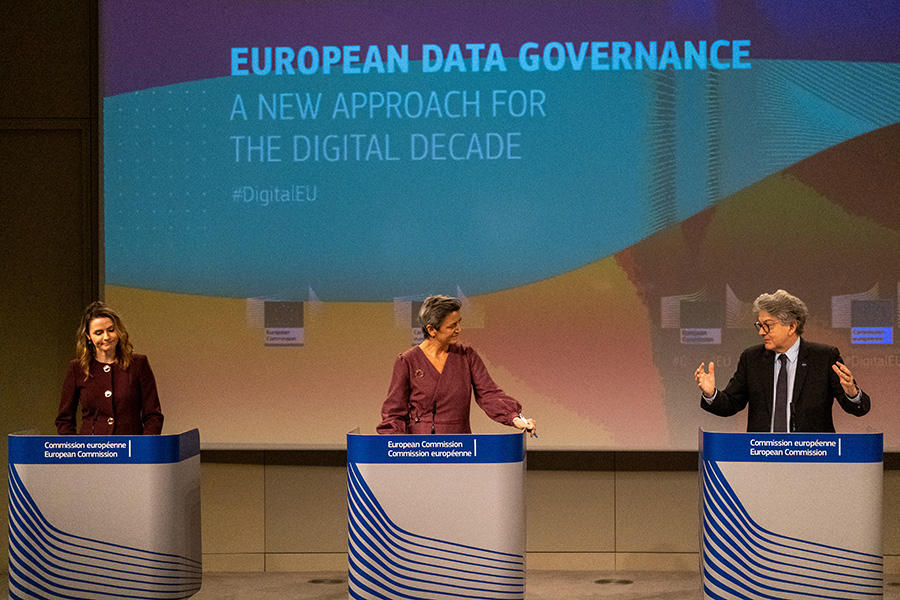

F. P. Oui. De fait, la loi informatique et libertés a été écrite surtout pour cibler l’administration – et non des acteurs privés. Et pour cause : à l’époque, Internet n’existait pas et les entreprises privées ne traitaient pas autant de données à caractère personnel. Il a donc fallu l’amender. Voilà pourquoi en 2016 le Parlement européen a adopté un nouveau texte permettant de mieux lutter contre l’utilisation des données personnelles par des sociétés privées : le « Règlement général sur la protection des données » ou RGPD. En vigueur depuis mai 2018, cette loi a consacré plusieurs nouveaux droits. C’est le cas du droit à la portabilité des données (article 20), qui donne la possibilité à l’utilisateur d’exiger que ses données personnelles confiées à une entreprise privée soit transférées à un concurrent si cela était nécessaire. Ou encore la nécessité d’un consentement explicite à l’usage des cookies sur les sites web pour tracer les personnes, et le contrôle de la possible réutilisation des données saisies dans les formulaires de contact.

À l’avenir, peut-on mieux protéger les utilisateurs des traitements algorithmiques ?

F. P. Oui. Notamment, en faisant en sorte que le RGPD soit mieux appliqué. Pour ce faire, il est crucial que le pouvoir politique accorde plus de moyens et de personnels aux agences chargées de faire respecter cette loi, afin qu’elles puissent contrôler et si besoin sanctionner de façon rapide et efficace. Pour ce qui est de l’amélioration de la loi même, il existe déjà des tentatives au niveau européen. Cela, pour mieux encadrer l’usage et la réutilisation des données et réguler les monopoles exercés dans ce domaine par les grandes entreprises du numérique, notamment les « Big Tech » (Google, Facebook, Amazon, Baidu, Alibaba, etc.). Ainsi, de nouveaux règlements, tels que le Digital Markets Act ou le Data Governance Act, sont en cours d’adoption en Europe, pour lutter contre les monopoles des géants du numérique et préserver les droits des personnes et des petites entreprises. ♦

A lire sur notre site

Algorithmes : l’injustice artificielle ? (entretien avec Sihem Amer-Yahia, informaticienne)

À l’usine, au bureau, tous remplacés par des robots ?

- 1. Laboratoire bordelais de recherche en informatique (LaBRI) ; CNRS/Université de Bordeaux/Institut polytechnique de Bordeaux.

- 2. Ces cartes sont des supports d’enregistrement de l’information, lues par des machines dites tabulatrices, où les informations étaient codées grâce à la présence ou l’absence de trous à des positions prédéfinies.

- 3. Projet Safari (Système automatisé pour les fichiers administratifs et le répertoire des individus), qui visait à identifier chaque citoyen par un numéro et à interconnecter, via ce numéro, tous les fichiers de l’administration.

Mots-clés

Partager cet article

Auteur

Journaliste scientifique freelance depuis dix ans, Kheira Bettayeb est spécialiste des domaines suivants : médecine, biologie, neurosciences, zoologie, astronomie, physique et nouvelles technologies. Elle travaille notamment pour la presse magazine nationale.

Commentaires

Connectez-vous, rejoignez la communauté

du journal CNRS